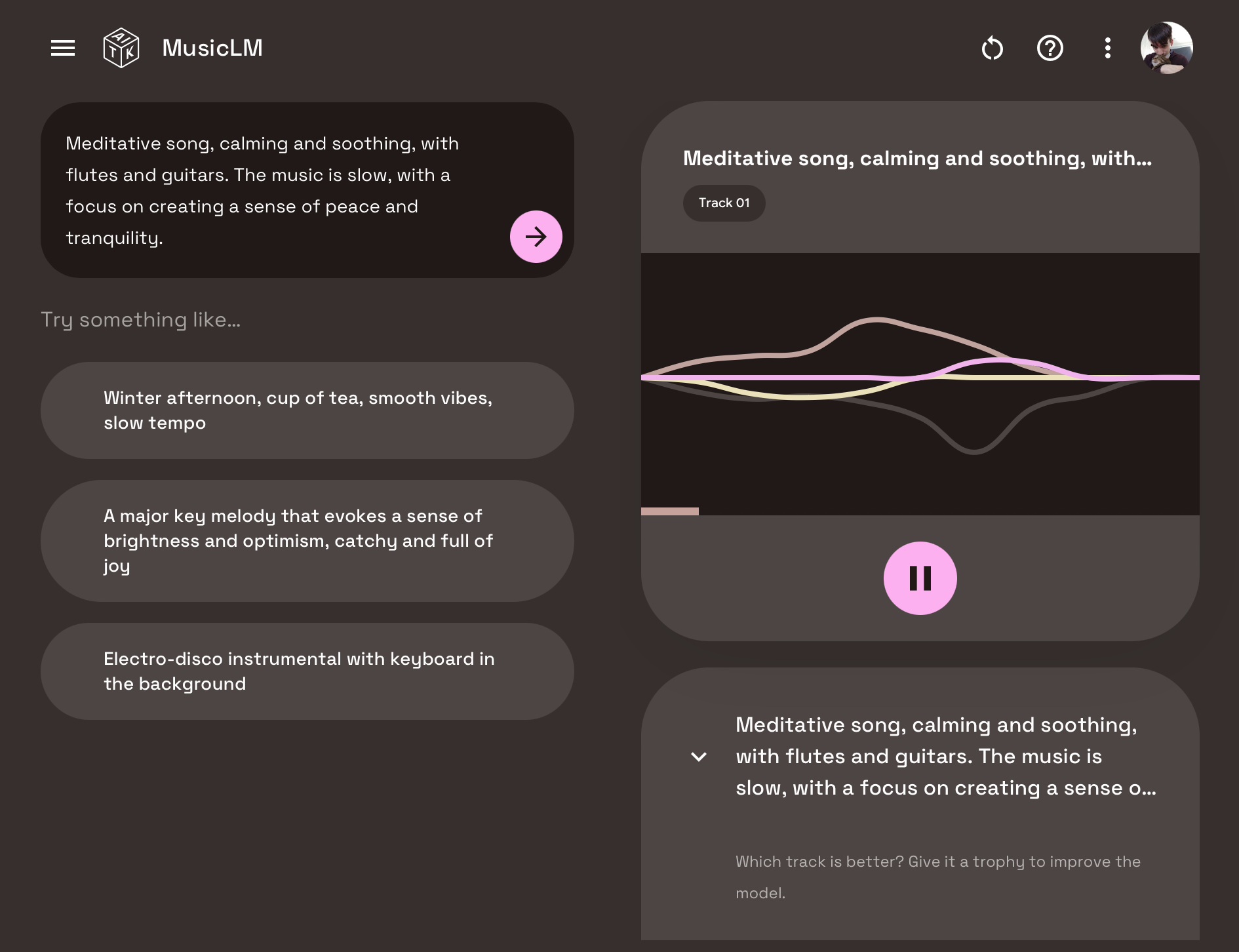

人工智能能否根据文本描述反向生成一首连贯的歌曲?这就是MusicLM的核心理念,这是Google在其I/O大会启动的一款AI驱动的音乐创作工具。

MusicLM通过数十万小时的音频进行训练,学习在多种风格中创作新音乐,现已通过Google的AI Test Kitchen应用进行预览。我和我的一些同事在过去的一天左右的时间里,一直在尝试使用它。

那么,结果如何呢?只能说MusicLM暂时无法取代音乐人的工作。

在Test Kitchen中使用MusicLM非常直观。一旦你获得访问权限,你将看到一个文本框,你可以在其中输入歌曲描述——细致入微也好,粗略一瞥也罢——然后让系统生成两个版本的歌曲。两个版本都可以下载进行离线收听,但Google鼓励你对其中一首歌曲进行“点赞”,以帮助提高AI的性能。

在今年一月份首次报道MusicLM时,这款产品还未发布,我写道,该系统创作的歌曲听起来有点像是人类艺术家可能创作的——尽管在音乐创新性或连贯性方面可能并非如此。现在,我不能完全坚持我之前的观点,因为很明显,年初的样本中存在一些严重的精选现象。

我用MusicLM生成的大多数歌曲听起来顶多算是勉强及格——最糟糕的情况就像是一个四岁的孩子在数字音频工作站(DAW)上随意弹奏。我主要坚持创作电子舞曲,试图产生一些有结构、可辨识(理想情况下还要愉快)的旋律。但不管MusicLM创作的歌曲开始听起来多么不错——甚至是很好!——总有一个时刻,它们会以一种非常明显、在音乐上不悦耳的方式崩溃。

例如,看看这个样本,它是用提示“轻快、欢快、飘逸的电子舞曲,适合跳舞。”生成的。一开始很有希望,有让人摇头的基线和经典的Daft Punk单曲的元素。但是到了音轨的中部,它突然偏离了轨道——几乎变成了另一种风格。

这是一个来自更简单提示的钢琴独奏——“浪漫且富有情感的钢琴音乐。”你会注意到,部分听起来非常好——甚至可以说是出色的,至少在手指操作方面是这样。但然后就好像钢琴家被狂热所控制。一串乱七八糟的音符之后,这首歌开始走向一个截然不同的方向,就好像是新的乐谱——尽管它与原来的风格相符。

我尝试让MusicLM来创作一些chiptunes(芯片音乐),想看看AI是否会更容易处理更基础构造的歌曲。结果并非如此。虽然结果(如下)的部分旋律容易让人上瘾,但最后还是和其他样本一样随机结束。

从积极的一面来看,总的来说,MusicLM比几年前OpenAI尝试创建的AI音乐生成器Jukebox做得要好得多。与MusicLM相比,只要给出一种音乐类型,一位艺术家和一段歌词片段,Jukebox就能生成相对连贯的音乐,并配有人声,但是Jukebox产生的歌曲缺乏像重复的合唱这样的典型音乐元素,而且经常包含无意义的歌词。MusicLM生成的歌曲也包含较少的人工元素,总的来说,在保真度方面感觉是一个升级。

除此之外,MusicLM的实用性有些受限,这要归功于提示方面的人为限制。它不会生成包含艺术家或人声的音乐,甚至不会生成特定音乐家的风格。尝试输入像“沿着Barry Manilow的风格”这样的提示,你只会得到一个错误信息。

原因可能是法律上的。深度伪造的音乐毕竟处于法律的灰色地带,一些音乐行业人士甚至认为,像MusicLM这样的AI音乐生成器侵犯了音乐版权。关于这个问题可能很快就会有所明晰——正在法院审理的几起诉讼可能会对音乐生成AI产生影响,包括一项与在未经其知情或同意的情况下使用艺术家作品来训练AI系统的权利相关的诉讼。时间会告诉我们答案。

然而,就目前来看,我认为艺术家们没有太多的理由担忧。MusicLM,就像最近发布的其他AI音乐生成器一样,它们更多的是揭示了这项技术还有多远的路要走。