OpenAI 的病毒式人工智能聊天机器人 ChatGPT 现在可以浏览互联网——在某些情况下。

OpenAI 今天推出了 ChatGPT 插件,通过授予机器人访问第三方知识源和数据库(包括网络)的权限来扩展机器人的功能。 OpenAI 向等待名单上的 ChatGPT 用户和开发人员提供 alpha 版,OpenAI 表示,在推出更大规模和 API 访问之前,它首先会优先考虑少数开发人员和订阅者使用其高级 ChatGPT Plus 计划。

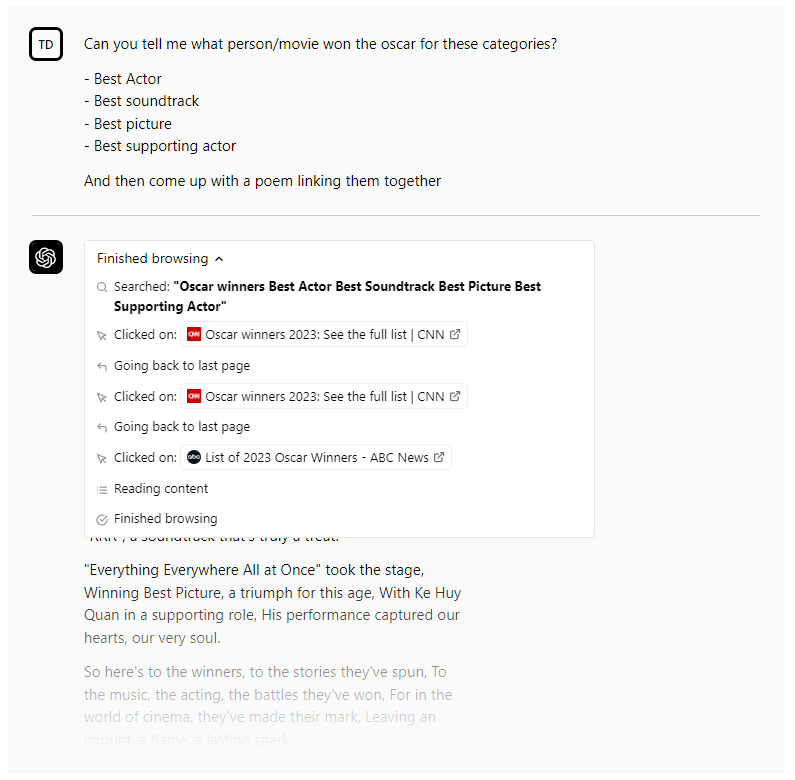

最吸引人的插件无疑是 OpenAI 的第一方网络浏览插件,它允许 ChatGPT 从网络上提取数据以回答向它提出的各种问题。 (以前,ChatGPT 的知识仅限于 2021 年 9 月左右之前的日期、事件和人物。)该插件使用 Bing 搜索 API 从网络上检索内容,并显示它在制作答案时访问过的任何网站,并在 ChatGPT 的回复中引用其来源。

正如 OpenAI 自己的研究所发现的那样,具有网络访问权限的聊天机器人是一个有风险的前景。 这家 AI 初创公司于 2021 年构建了一个名为 WebGPT 的实验系统,该系统有时会引用不可靠的来源,并被激励从它希望用户会觉得有说服力的网站中挑选数据——即使这些来源客观上并不是最强大的。 Meta 已解散的 BlenderBot 3.0 也可以访问网络,并迅速偏离正轨,在出现特定文本提示时钻研阴谋论和令人反感的内容。

与静态训练数据集相比,实时网络的策划更少,当然,这也意味着过滤更少。 谷歌和 Bing 等搜索引擎使用自己的安全机制来减少不可靠内容出现在结果顶部的可能性,但这些结果可以被玩弄。 它们也不一定代表整个网络。 正如《纽约客》中的一篇文章所指出的那样,谷歌的算法会优先考虑使用加密、移动支持和模式标记等现代网络技术的网站。 结果,许多具有其他优质内容的网站在洗牌中迷失了方向。

这使搜索引擎对数据有很大的控制权,这些数据可能会告知网络连接的语言模型的答案。 人们发现谷歌在搜索中优先考虑自己的服务,例如,使用来自谷歌地方的数据而不是像 TripAdvisor 这样更丰富、更社交的来源来回答旅行查询。 与此同时,算法搜索方法为不良行为者打开了大门。 据《纽约客》报道,2020 年,Pinterest 利用谷歌图像搜索算法的一个怪癖,在谷歌图像搜索中展示了更多其内容。

OpenAI 承认,支持网络的 ChatGPT 可能会执行所有类型的不良行为,例如发送欺诈性和垃圾邮件、绕过安全限制以及通常“增加欺诈、误导或滥用他人的不良行为者的能力”。 但该公司还表示,内部和外部红队通知它“实施了多项保障措施”以防止这种情况发生。 时间会证明它们是否足够。

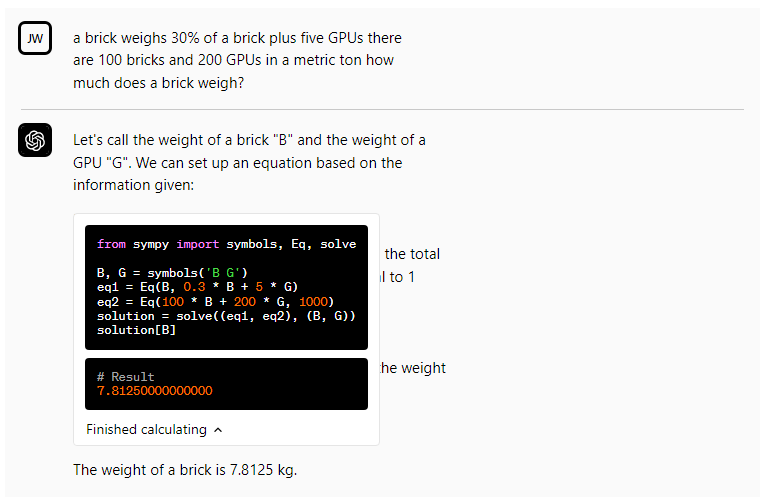

除了网络插件之外,OpenAI 还为 ChatGPT 发布了一个代码解释器,它为聊天机器人提供了一个在沙盒、防火墙环境和磁盘空间中工作的 Python 解释器。 支持上传文件到ChatGPT并下载结果; OpenAI 表示,它对于解决数学问题、进行数据分析和可视化以及在格式之间转换文件特别有用。

许多早期合作者为 ChatGPT 构建了插件以加入 OpenAI 自己的插件,包括 Expedia、FiscalNote、Instacart、Kayak、Klarna、Milo、OpenTable、Shopify、Slack、Speak、Wolfram 和 Zapier。

它们在很大程度上是不言自明的。 例如,OpenTable 插件允许聊天机器人跨餐厅搜索可用预订,而 Instacart 插件允许 ChatGPT 从本地商店下订单。 迄今为止,Zapier 是同类产品中最具可扩展性的,它可以与 Google 表格、Trello 和 Gmail 等应用程序连接,以触发一系列生产力任务。

为了促进新插件的创建,OpenAI 开源了一个“检索”插件,使 ChatGPT 能够通过用自然语言提问来访问来自文件、笔记、电子邮件或公共文档等数据源的文档片段。

“我们正在努力开发插件并将它们带给更广泛的受众,”OpenAI 在一篇博文中写道。 “我们有很多东西要学,在大家的帮助下,我们希望打造出既有用又安全的东西。”

插件是 ChatGPT 开发时间表中一个奇怪的补充。 一旦仅限于其训练数据中的信息,ChatGPT 有了插件,突然变得更加强大——而且可能法律风险也更低。 一些专家指责 OpenAI 从训练 ChatGPT 的未经许可的工作中获利; ChatGPT 的数据集包含各种各样的公共网站。 但是插件可以通过允许公司保留对其数据的完全控制来解决该问题。

参考报道:

此处内容需要权限查看